Inicio / Tecnología

AGI: El Debate Imperecedero sobre el Futuro de la Inteligencia Artificial General y el Monopolio

Explora la **IA Estrecha** vs. **AGI**, los miedos a un monopolio de la IA, y el papel de **Elon Musk** y **OpenAI**.

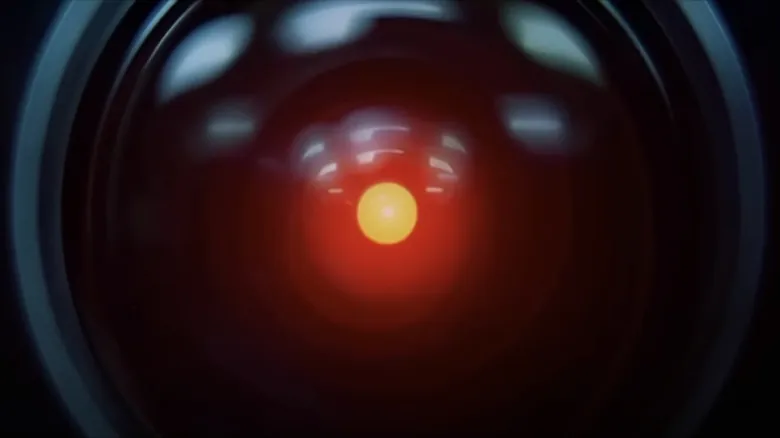

Hasta hace poco, la visión popular de la Inteligencia Artificial (IA), influenciada por obras de la cultura pop como HAL 9000 de “2001: Una odisea del espacio” o Skynet de “Terminator”, la situaba en un futuro distante. Sin embargo, en años recientes, la IA se ha convertido en una presencia muy real en nuestro mundo. Específicamente, un tipo particular de tecnología ha cobrado gran relevancia: la IA Estrecha.

Este término se refiere a una forma de IA diseñada para realizar una tarea específica: jugar ajedrez, generar imágenes, escribir textos, entre otras. La IA Estrecha nos rodea y lo ha hecho durante algún tiempo; basta con pensar en la existencia de las calculadoras. Pero la irrupción de los Modelos de Lenguaje Grandes (LLMs), los generadores de arte por IA y la IA capaz de componer canciones completas de forma independiente ha marcado una nueva era para la IA Estrecha, una lo suficientemente significativa como para generar gran preocupación. Desde las huelgas de Hollywood, donde la escritura de guiones por IA fue un tema central, hasta la ansiedad generalizada sobre qué empleos serán reemplazados por esta tecnología emergente, la nueva era de la IA Estrecha ya se perfila como un momento potencialmente revolucionario.

Pero el hecho de que la influencia de la IA Estrecha esté creciendo no significa que la amenaza de una inteligencia autoconsciente, al estilo de Skynet, haya desaparecido. De hecho, muchas personas increíblemente inteligentes están sumamente preocupadas por la llegada de lo que comúnmente se conoce como Inteligencia Artificial General (AGI). Entre ellos se encuentra Elon Musk, quien expresó preocupaciones muy específicas y escalofriantes sobre el proyecto DeepMind de Google cuando ayudó a cofundar la ahora omnipresente OpenAI en 2015.

Elon Musk cofundó OpenAI para protegerse de una dictadura de la IA

Preguntar si la Inteligencia Artificial es buena o mala simplifica demasiado el problema. Para empezar, existen múltiples tipos de IA, y el tipo que puede leer artículos científicos antiguos y hacer un descubrimiento, por ejemplo, no es tan alarmante. Sin embargo, al centrarse únicamente en la AGI, las opiniones difieren sobre si tal cosa será un beneficio neto o un perjuicio neto para el mundo, e incluso entonces, el tema es mucho más complejo.

La AGI se concibe típicamente como una forma de Inteligencia Artificial similar a la mente humana, capaz de llevar a cabo diversas tareas y adaptarse a situaciones, al igual que nuestro propio cerebro. Desarrollar una IA de este tipo conlleva todo tipo de consideraciones, desde el llamado problema de alineación, que se centra en asegurar que la tecnología esté alineada con los valores de la humanidad, hasta el problema de contención, que busca mantener una inteligencia artificial de nivel humano bajo control humano.

Para Elon Musk y Sam Altman, la verdadera preocupación era quién, exactamente, desarrollaría una AGI primero y cómo la usaría. Esta fue una parte importante de por qué ambos cofundaron OpenAI como una organización sin fines de lucro en 2015, con la esperanza de evitar que la IA de nivel humano cayera bajo el control exclusivo de gigantes tecnológicos como Google, que en 2014 había adquirido la empresa de investigación de IA DeepMind. Ahora, correos electrónicos recientemente publicados han revelado la magnitud de la preocupación de Musk y sus colegas por el desarrollo de una verdadera dictadura de AGI bajo el control de Google.

Elon Musk demandó a OpenAI y reveló correos electrónicos internos

En su sitio web, DeepMind se presenta como “un equipo de científicos, ingenieros, expertos en ética y más, trabajando para construir la próxima generación de sistemas de IA de forma segura y responsable”. Pero parece que Elon Musk no se dejó convencer por tal lenguaje utópico. Él y Sam Altman fundaron OpenAI con el objetivo de asegurar que ninguna gran compañía tecnológica, especialmente Google, desarrollara la AGI primero y así obtuviera la oportunidad de establecer control sobre la tecnología.

Desde entonces, el experimento de OpenAI ha cambiado drásticamente, convirtiéndose en una empresa con fines de lucro, mientras que Musk la ha dejado para fundar su propia firma, xAI. El empresario tecnológico también ha demandado a su antigua empresa en múltiples ocasiones, presentando una demanda y varias enmiendas a lo largo de 2024, alegando que OpenAI, la empresa detrás del inmensamente popular chatbot ChatGPT, se ha convertido esencialmente en aquello que se propuso evitar, o lo que los documentos judiciales denominan una “Gorgona con fines de lucro, paralizadora del mercado” (vía la BBC). Un portavoz de OpenAI declaró a la cadena: “El tercer intento de Elon en menos de un año para reformular sus afirmaciones es aún más infundado y excesivo que los anteriores.”

Dejando a un lado las diversas afirmaciones que se hacen en la demanda, una cosa que ha surgido de toda la debacle ha sido la publicación de numerosos correos electrónicos de la época de la fundación de OpenAI, muchos de los cuales revelan la profundidad de los temores de Musk y sus colaboradores sobre una dictadura de AGI.

Los fundadores de OpenAI querían prevenir un monopolio de AGI

Según Transformer, en un correo electrónico de 2016, Elon Musk escribió que DeepMind le estaba “causando estrés mental extremo”. Al empresario le preocupaba que si DeepMind creara una AGI primero, eso sería una mala noticia para todos los demás, específicamente debido a lo que Musk percibía como la “filosofía de una mente para gobernar el mundo” de la compañía. En su opinión, el fundador de DeepMind, Demis Hassabis, podría crear fácilmente una dictadura de AGI al ser el primero en desarrollar Inteligencia Artificial de nivel humano.

No era solo Musk quien estaba tan preocupado por las ambiciones de AGI de DeepMind y Google. El cofundador de OpenAI, Sam Altman, también envió un correo electrónico en 2015 en el que reveló que había pasado mucho tiempo reflexionando si era posible evitar que la humanidad desarrollara IA, llegando a la conclusión de que la respuesta era “casi definitivamente no”. Como tal, compartió la opinión de Musk de que las primeras personas en desarrollar una AGI no deberían ser una corporación masiva como Google, escribiendo: “Si de todos modos va a suceder, parece que sería bueno que alguien que no sea Google lo hiciera primero.”

Además, otros dos cofundadores de OpenAI, Ilya Sutskever y Trevor Blackwell, expresaron su preocupación por el desarrollo de AGI por parte de DeepMind. En un correo electrónico, la pareja describió a OpenAI como un proyecto destinado a evitar una dictadura de AGI. “Le preocupa que [el CEO de DeepMind, Demis Hassabis] pueda crear una dictadura de AGI”, escribieron, “A nosotros también” (vía The Verge).

¿A qué se debe tanta ansiedad por la AGI?

Es imposible decir cómo será el desarrollo de una verdadera Inteligencia Artificial General o cómo afectará al mundo. Pero hay personas muy inteligentes que están muy preocupadas por ello. Nick Bostrom, autor, profesor de Oxford y exdirector del Future of Humanity Institute de la universidad, ha sido uno de los más vocales sobre el tema, sobre todo con su libro de 2016 “Superintelligence”. En el libro, Bostrom escribe: “Ante la perspectiva de una explosión de inteligencia, los humanos somos como niños pequeños jugando con una bomba”. Como el profesor le dijo más recientemente a Wired: “Creo que sería deseable que quienquiera que esté a la vanguardia del desarrollo de los sistemas de IA de próxima generación, particularmente los sistemas superinteligentes verdaderamente transformadores, tuviera la capacidad de pausar durante las etapas clave. Eso sería útil para la seguridad.”

No está claro si DeepMind, o cualquier gran empresa tecnológica que desarrolle IA, tendrá este tipo de salvaguardias implementadas, a pesar de sus afirmaciones de trabajar de forma “segura”. Dicho esto, hay muchas personas informadas que sostienen que el llamado “doomismo de la IA” es simplemente erróneo y que no hay nada de qué preocuparse.

Lo que sí está claro, sin embargo, es que mientras Google DeepMind sigue facilitando la identificación de texto generado por IA y ayudando a poner marcas de agua a los productos de la IA Estrecha actual, hay un panorama más amplio en todo esto. Esa imagen no es del todo clara, pero la AGI está en el centro, y no solo Elon Musk está preocupado por algo así.