Inicio / Tecnología

Inteligencia Artificial en la Educación: Desafíos, Ética y el Futuro del Aprendizaje

La IA transforma la educación, enfrentando desafíos como el plagio y sesgos, mientras abre puertas a un aprendizaje más humano e innovador.

El 30 de noviembre de 2022, OpenAI lanzó ChatGPT con poca fanfarria. Dos meses después, la plataforma alcanzó los 100 millones de usuarios activos mensuales, convirtiéndose en la aplicación de más rápido crecimiento en la historia. Cualquier industria y campo que lidiara con eso que llamamos lenguaje humano pronto enfrentaría un cambio radical, y el ámbito de la educación no fue la excepción. Universidades e instituciones educativas de casi todos los niveles entraron en un pánico frenético: ¿cómo podrían los docentes confiar en que lo que sus estudiantes hacían fuera del aula se originaba en su propia inteligencia y no en la de las máquinas?

La respuesta parecía residir en la misma tecnología que creó el problema: los detectores de IA. Se pensó que podrían ser la solución mágica para los profesores que buscaban diferenciar el esfuerzo y la reflexión de la pereza y el engaño. Pero incluso antes de que programas como ChatGPT irrumpieran en escena, los detectores de plagio eran conocidos por dar falsos positivos a los profesores, lo que llevaba a que los estudiantes fueran reprendidos injustamente. La IA solo ha exacerbado este problema. Ahora, los estudiantes pueden producir ensayos de una calidad convincente con solo unos pocos clics, descargando cognitivamente el ejercicio mental destinado a educarlos en el proceso. Los docentes, en un intento por no quedarse atrás en la carrera armamentista tecnológica, están comenzando a depender en gran medida de los detectores de plagio de IA que continúan etiquetando erróneamente el contenido original como generado por IA, con consecuencias desastrosas para los estudiantes acusados de hacer trampa.

Aquí, analizaremos cómo la IA ha afectado a las escuelas y programas educativos en todo el mundo, desde el aumento de la posibilidad de trampa estudiantil hasta la dependencia tecnológica y más. Pero, igual de importante, profundizaremos en la razón por la cual los inconvenientes más flagrantes de esta tecnología también podrían esconder su mayor beneficio: cómo las instituciones se están viendo obligadas a considerar hacer que la educación sea cada vez más humana frente a un cambio tecnológico sin precedentes.

Trampas con Inteligencia Artificial

El auge de las herramientas de IA como ChatGPT ha introducido una poderosa nueva vía para la deshonestidad académica, haciendo más fácil que nunca para los estudiantes eludir los procesos de aprendizaje tradicionales para obtener una calificación y aprobar la materia. Aparte de la escritura de ensayos estándar, que es el patrón oro para evaluar la capacidad de un estudiante para pensar críticamente y sintetizar información en un argumento coherente y convincente, las plataformas de IA pueden resolver problemas matemáticos complejos (con diversos grados de éxito) e incluso generar código de computadora con una entrada relativamente mínima. Esta facilidad de uso y la calidad aparente de los resultados generados plantean serias preguntas sobre la integridad académica.

Los instructores no son muy hábiles para detectar cuándo se utilizan estas herramientas. En un estudio publicado en la revista PLOS One, investigadores que se hicieron pasar por estudiantes universitarios presentaron ensayos totalmente generados por IA en sistemas de evaluación de un programa de psicología en el Reino Unido. ¿El resultado? El 94% de las entregas de IA pasaron desapercibidas. El potencial de uso indebido se extiende más allá de la escritura. En las clases de informática, a los profesores les preocupa que programas como GitHub Copilot, la herramienta de sugerencia de código de Microsoft, signifiquen que tienen que reestructurar completamente la forma en que imparten sus cursos.

Los estudiantes están aprovechando la oportunidad. Cientos de casos de trampas relacionadas con la IA en Escocia han sido reportados en los últimos dos años. Un estudiante en Turquía fue arrestado recientemente por usar IA en un examen de ingreso a la universidad. Había utilizado de manera bastante ingeniosa una cámara disfrazada de botón de camisa vinculada a un software de IA a través de un router escondido en su zapato. El software generaba las respuestas correctas, que luego eran transmitidas al estudiante a través de un auricular. Este incidente subraya la sofisticación creciente de los métodos de engaño impulsados por IA.

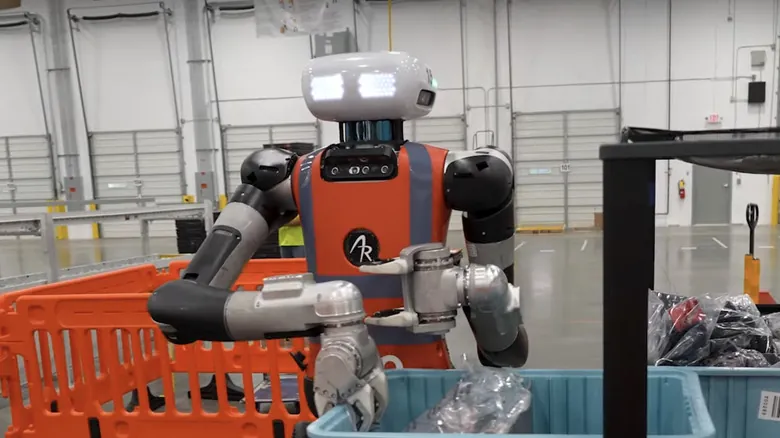

Sobredependencia Tecnológica

La integración de la IA en las aulas ha traído eficiencia e innovación, pero también ha planteado preocupaciones sobre la sobredependencia. Investigaciones publicadas en la revista Computers & Education indican que el uso estudiantil de la IA resulta en una menor agencia individual, lo que significa que en lugar de aprender de la tecnología, los estudiantes llegan a depender de ella. Tales estudios sugieren que desarrollar nuevas metodologías híbridas humano-IA en el aula podría ser de creciente importancia para fomentar un aprendizaje activo.

Los docentes también dependen cada vez más de herramientas de IA como los detectores de plagio, que son conocidos por generar falsos positivos. Según una encuesta publicada por el Center for Democracy & Technology, al menos dos tercios de una muestra representativa a nivel nacional de 460 instructores en todo EE. UU. utilizan tales herramientas de detección de contenido de IA, una cifra que contrasta fuertemente con la evidencia de la ineficacia de esas herramientas. Curiosamente, los investigadores que trabajan en OpenAI han desarrollado una especie de técnica de marca de agua de IA que es consistente y efectiva en su metodología de detección. Sin embargo, las presiones del mercado mantienen esa herramienta bajo llave, ya que su lanzamiento probablemente resultaría en que los usuarios de ChatGPT se dirijan a los competidores de OpenAI, lo que no haría mucho para paliar el problema general. Sin embargo, nuevos esfuerzos de Google podrían facilitar la identificación de texto generado por IA.

Incluso los procesos de calificación se han adaptado para incorporar herramientas de IA. Los instructores están recurriendo a ChatGPT y sus similares para calificar ensayos y otros trabajos de proyectos de manera más eficiente, algo que ha causado una división entre los educadores sobre la ética y la efectividad de hacerlo. Más allá de ese debate, incluso solo subir el trabajo de un estudiante a una plataforma de IA sin su consentimiento podría constituir una violación masiva de la privacidad. Esto plantea serias preguntas sobre la seguridad de los datos y la ética profesional.

La Propagación de Desinformación

Los sistemas de IA impulsados por modelos de lenguaje grandes son conocidos por su tendencia a “alucinar”, es decir, presentar información errónea de una manera muy convincente y con un tono autoritario que puede ser sorprendentemente difícil de detectar, incluso para usuarios experimentados. En el contexto de las instituciones educativas, cuyo objetivo explícito es transmitir hechos e impartir la capacidad de discernir la realidad de la falsedad a su alumnado, esto es particularmente problemático. La confiabilidad de la información se convierte en un desafío central.

El problema está lejos de ser teórico. En diciembre de 2023, un estudiante de Hingham High School en Massachusetts recibió una calificación reprobatoria en un proyecto de Historia de EE. UU. AP después de copiar texto de un programa de IA y enviarlo como propio. El texto que el estudiante envió incluía varias citas a fuentes inexistentes, pura alucinación por parte de la IA. Alegando que la escuela no tenía una política anti-IA en sus libros, los padres del estudiante demandaron a la escuela para modificar la calificación y borrar el escándalo de su expediente, una orden que el Tribunal de Distrito de EE. UU. para el Distrito de Massachusetts rechazó. Este caso resalta la necesidad urgente de políticas claras sobre el uso de IA en el ámbito académico.

La educación superior no está exenta del problema. Un estudio de investigación publicado en Scientific Reports encontró que el 55% y el 18% de las revisiones de literatura producidas por ChatGPT-3.5 y ChatGPT-4, respectivamente, fabricaron citas bibliográficas para las cuales no existe ningún trabajo académico. Como siempre, los instructores también tienen sus propios escollos a los que prestar atención. A medida que más profesores comienzan a incorporar la IA en sus procedimientos de planificación de lecciones, las posibilidades de que una autoridad educativa presente involuntariamente información errónea como factual a sus estudiantes aumentan significativamente. La verificación de hechos se vuelve más crítica que nunca.

Sesgos en los Conjuntos de Datos

Las herramientas impulsadas por IA han revolucionado el aprendizaje personal, pero su dependencia de vastos conjuntos de datos no filtrados ha introducido un inconveniente significativo: la amplificación de sesgos. El sesgo algorítmico se produce cuando los algoritmos desfavorecen a ciertos grupos más que a otros, ya sea que la característica demográfica sea el género, la raza, la nacionalidad o cualquier otra. Cuando los desarrolladores de tecnología entrenan modelos con datos que replican los sesgos existentes, a sabiendas o no, esto puede tener graves efectos posteriores en los individuos que utilizan estos sistemas. Esto subraya la importancia de la ética en el diseño de IA.

Incluso OpenAI lo reconoce abiertamente, afirmando en su sitio web que los educadores deben tener precaución al revisar las salidas de ChatGPT, dado que se inclina hacia las visiones occidentales y favorece las entradas en inglés. El sesgo contra hablantes no nativos de inglés en los sistemas de IA en general también es un problema, ya que algunos detectores de IA etiquetan la escritura de estos estudiantes como generada por IA a una tasa más alta que el trabajo de hablantes nativos. Esto puede llevar a acusaciones injustas y afectar la equidad en la evaluación.

La IA también se utiliza en instituciones educativas como herramienta analítica predictiva. A menudo, estas herramientas se emplean para determinar la probabilidad de que un estudiante se gradúe de la escuela secundaria, por ejemplo. Si bien están destinadas a ayudar a los educadores a apoyar mejor a los estudiantes en sus trayectorias académicas, a menudo no cumplen su objetivo, etiquetando incorrectamente a las minorías raciales como menos propensas a prosperar. Uno de esos sistemas en Wisconsin, introducido en 2012, identificó consistentemente a estudiantes de ascendencia negra e hispana como en riesgo de no graduarse de la escuela secundaria. El problema es que el algoritmo que utilizó el estado estaba equivocado en casi las tres cuartas partes de las ocasiones, creando una percepción injusta de los estudiantes de minorías en la mente de los educadores. Esto evidencia la necesidad de una supervisión humana rigurosa y una auditoría constante de estos sistemas.

Aprovechando la IA para el Bien en el Aula

A pesar de todos los inconvenientes de las tecnologías de IA, tienen el potencial de transformar las aulas para mejor cuando se usan de manera reflexiva para mejorar la experiencia de enseñanza y aprendizaje. Si los educadores pueden incorporar eficazmente estas herramientas en una experiencia más eficiente, enriquecedora y centrada en el ser humano para los alumnos, el impacto y los desafíos que ChatGPT y sus competidores han entregado a las instituciones de todo el mundo podrían, contraintuitivamente, terminar siendo la fuente del mayor beneficio de la tecnología para el campo. La clave reside en un enfoque pedagógico equilibrado.

La investigación está comenzando a mostrar que las herramientas de IA son excelentes socios de lluvia de ideas para los estudiantes, sirviendo como la chispa inicial para flujos de curiosidad e investigación. Crucialmente, sin embargo, los estudiantes deben tener la oportunidad de ejercitar y establecer su creatividad antes de usar herramientas como ChatGPT, que pueden ser introducidas más tarde para extender su aprendizaje. Esencialmente, la IA puede ser excelente como una especie de tutor para proporcionar explicaciones que enriquezcan el pensamiento crítico, pero usarla como un generador de respuestas probablemente impedirá el aprendizaje más que cualquier otra cosa. Para los profesores, la retroalimentación impulsada por IA e incluso la generación de actividades en tiempo real se encuentran entre las aplicaciones más inspiradoras de la tecnología, fomentando un ambiente más receptivo y orientador para los alumnos.

Como en todas las cosas, un equilibrio considerado con la IA en la educación parece ser la clave para desbloquear su potencial y minimizar su daño. El futuro de la educación no es reemplazar al docente o al alumno con máquinas, sino empoderarlos con herramientas inteligentes que potencien sus capacidades humanas. Si estás interesado en aprender más sobre el impacto de la IA en el mundo, lee nuestro análisis de la inquietante preocupación que Elon Musk tenía sobre la IA DeepMind de Google y la amenaza que la IA Gemini de Google supuestamente le dijo a un estudiante.